Meta AI 发布 MobileLLM-R1:轻量级边缘推理模型,参数不足 10 亿,性能提升显著

作者:AIbase基地 更新时间:2025-09-16 17:17:32 共262人关注

Meta AI 近日推出了 MobileLLM-R1,这是一系列轻量级边缘推理模型,目前已在 Hugging Face 上发布。该系列模型参数范围从140M 到950M,专注于高效的数学、编码和科学推理,且在不足10亿的参数规模下实现了优秀的性能表现。

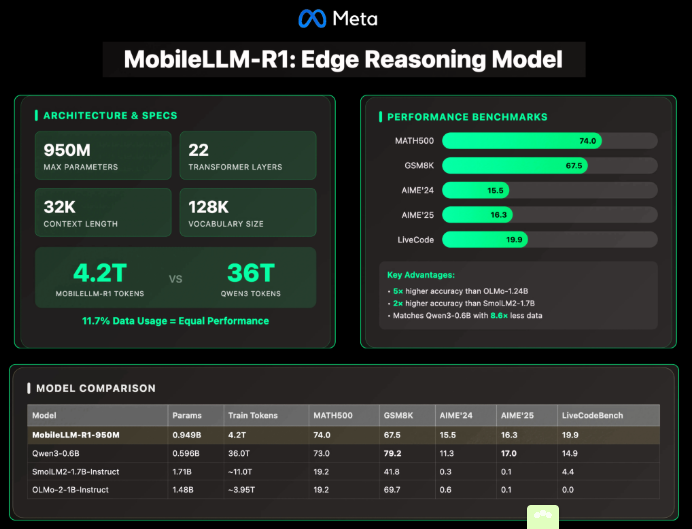

MobileLLM-R1的最大模型为 MobileLLM-R1-950M,采用了一系列架构优化设计:包括22层 Transformer 结构、24个注意力头和6个分组 KV 头。模型的嵌入维度为1536,隐藏层维度为6144。此外,模型还采用了分组查询注意力(GQA)来减少计算和内存需求,块级权重共享技术降低了参数数量而不显著增加延迟,SwiGLU 激活函数提升了小模型的表示能力。模型支持4K 的上下文长度和32K 的后训练模型。

在训练效率方面,MobileLLM-R1的表现同样引人注目。该模型总共在约4.2万亿个 token 上进行训练,相较于 Qwen3的0.6B 模型训练的36万亿 token,MobileLLM-R1仅使用了约11.7% 的数据便达到了或超越了 Qwen3的准确率。同时,模型在数学、编码和推理数据集上进行了监督微调,从而降低了训练成本和资源需求。

在各项基准测试中,MobileLLM-R1-950M 的表现优异:在 MATH500数据集上,其准确率比 OLMo-1.24B 高出约5倍,且比 SmolLM2-1.7B 高出约2倍。在 GSM8K、AIME 和 LiveCodeBench 等推理和编码任务上,MobileLLM-R1甚至与 Qwen3-0.6B 相匹配或超越,尽管所使用的 token 数量远少于后者。

不过,MobileLLM-R1的聚焦也带来了局限性。虽然在数学、编码和结构化推理方面表现强劲,但在一般对话、常识推理和创造性任务上,MobileLLM-R1的表现较大型模型有所不足。此外,模型在生产环境中的使用受到 FAIR NC(非商业)许可证的限制,较长的上下文(32K)也提高了推理时的 KV 缓存和内存需求。

总的来看,Meta 的 MobileLLM-R1展现了一个趋势,即朝着更小、更专业化的模型方向发展,能够在不需要大规模训练预算的情况下实现竞争力的推理能力。该模型在数学、编码和科学应用场景中表现尤为突出,为边缘设备上的大规模语言模型部署定义了新的标准。

项目:https://huggingface.co/facebook/MobileLLM-R1-950M

划重点:

🧩 ** 新模型发布 **:Meta AI 推出 MobileLLM-R1系列轻量级边缘推理模型,参数范围从140M 到950M。

📊 ** 训练效率 **:MobileLLM-R1仅用约11.7% 的数据训练,表现出色,训练成本和资源需求显著降低。

💡 ** 性能优势 **:在多项基准测试中,MobileLLM-R1-950M 表现超越多款大型开源模型,尤其在数学和编码任务上。